by drmunozcl

Share

Por drmunozcl

Compartir

La inteligencia artificial acelera procesos, reduce costos y abre nuevas líneas de negocio. Pero también multiplica la superficie de ataque, automatiza fraudes y pone en riesgo datos sensibles. En otras palabras, vivimos con una IA como amenaza y aliada. La cuestión no es elegir un bando, sino aprender a equilibrar innovación y seguridad para crecer sin quedar expuestos.

IA como amenaza y aliada: principios para equilibrar innovación y seguridad

Si tu empresa incorpora IA generativa, asistentes de código o chatbots, aumenta la productividad y, a la vez, la responsabilidad. Los atacantes ya usan modelos para crear phishing impecable, deepfakes convincentes y malware mutante. Mientras tanto, tu equipo puede usar IA para detectar anomalías, priorizar vulnerabilidades y automatizar respuestas. La ventaja será de quien establezca reglas claras: datos bien gobernados, controles de acceso sólidos y un ciclo de vida de modelos con seguridad integrada.

El equilibrio surge cuando conviertes la IA en una extensión de tus controles de ciberseguridad y cumplimiento, no en un atajo que ignora políticas. Adoptar marcos como NIST AI RMF, ISO/IEC 27001 y 27701, y principios Zero Trust te permite innovar con menos fricción y más evidencia.

Riesgos reales potenciados por IA (y cómo encararlos)

- Phishing y fraude asistido por IA: correos perfectos, voz y video clonados. Respuesta: MFA, verificación fuera de banda, concienciación continua y filtros antiphishing con análisis de comportamiento.

- Prompt injection y exfiltración de datos en LLM: usuarios o atacantes inducen al modelo a filtrar secretos. Respuesta: sanitización de prompts, separación de contextos, reglas de no revelación, clasificación de contenido y registro de prompts.

- Envenenamiento de datos y robo de modelo: manipulan datasets o extraen pesos mediante consultas. Respuesta: validación de datasets, control de integridad, rate limiting, watermarking y monitoreo de abuso.

- Shadow AI: empleados cargan datos en servicios no aprobados. Respuesta: catálogo de herramientas aprobadas, DLP, políticas claras y alternativas corporativas seguras.

- Cumplimiento y privacidad: uso de datos personales sin base legal o evaluaciones de impacto. Respuesta: minimización de datos, cifrado, retención limitada, DPIA, consentimiento y contratos con proveedores.

Un apunte con humor serio: los deepfakes no piden permiso; tus controles tampoco deberían hacerlo.

Cómo usar la IA como aliada de la ciberseguridad

- Detección y respuesta: combinar EDR/XDR con IA para reducir falsos positivos y acelerar el triage. Integra señales en tu SIEM/SOAR.

- Prioridad de vulnerabilidades: modelos que cruzan CVEs con exposición real (asset criticality, explotabilidad) y recomiendan parches por impacto.

- Análisis de comportamiento: detección de anomalías en red (NDR) y accesos (IAM) para frenar movimientos laterales.

- Asistentes seguros para el SOC: playbooks guiados por IA con límites estrictos, revisión humana y trazabilidad.

- Seguridad en el ciclo de vida del modelo: MLOps/LLMOps con controles de datos, pruebas de robustez y red teaming específico de IA.

Plan en 8 pasos para equilibrar innovación y seguridad

- Define objetivos de negocio para la IA: productividad, atención al cliente, detección de fraudes. Sin propósito, no hay control.

- Clasifica y gobierna los datos: inventario, etiquetas de sensibilidad, DLP, cifrado en tránsito y reposo, y mínimos privilegios (RBAC/PAM).

- Implementa Zero Trust: MFA en todo, segmentación, verificación continua de identidad y postura del dispositivo (MDM/EMM).

- Estandariza herramientas de IA: crea un catálogo aprobado, políticas de uso y un proceso de excepciones. Bloquea Shadow AI con CASB/SSE.

- Asegura LLM y pipelines: filtrado de prompts, aislamiento de contextos, control de tokens, rate limiting y registro auditable. Valida datasets.

- Integra monitoreo y respuesta: conecta logs de IA al SIEM; crea casos de uso en SOAR para incidentes de contenido sensible o abuso de API.

- Prueba y ejerce: red teaming de IA (ataques de prompt injection, jailbreak, data leakage) y simulacros de respuesta con equipos TI y legales.

- Cumple y documenta: mapea controles a NIST AI RMF, ISO 27001/27701 y privacidad (GDPR/leyes locales). Realiza DPIA y revisiones periódicas.

Casos rápidos

- Pyme con chatbot interno: habilita un LLM privado con filtros de contenido y anonimización; reduce tiempos de respuesta 40% sin filtrar datos sensibles.

- Retail con fraude de voz: implementa verificación fuera de banda y análisis de audio; cae 70% la aprobación de órdenes fraudulentas.

- Fábrica con mantenimiento predictivo: IA detecta anomalías; con segmentación de red y acceso Just-in-Time, evita movimientos laterales tras un compromiso de OT.

Errores comunes que frenan el equilibrio

- Lanzar pilotos sin gobierno de datos ni política de uso aceptable.

- Confiar en la «caja negra» del proveedor sin auditoría ni registros.

- No involucrar a legal y compliance desde el diseño.

- Medir éxito solo por velocidad, no por riesgo reducido ni calidad.

Conclusión

La IA no es buena ni mala por defecto: amplifica lo que ya tienes. Con controles robustos, datos gobernados y prácticas de MLOps seguras, conviertes la IA como amenaza y aliada en una ventaja competitiva sostenible. El truco no es frenar la innovación, sino dirigirla con disciplina. Empieza pequeño, mide, mejora y escala: seguridad primero, velocidad siempre.

MANTENTE INFORMADO

Suscríbete a nuestro newsletter gratuito.

La inteligencia artificial ya no es solo una herramienta para empresas y desarrolladores. En 2026, investigadores de ciberseguridad han detectado una nueva generación de amenazas que integran modelos de lenguaje (LLMs) directamente en su funcionamiento. Dos nombres están marcando tendencia en el mundo de la seguridad informática: PromptFlux y QuietVault. Estos malwares representan un cambio

La conversación dejó de ser “si me van a atacar” y pasó a “cuándo, cómo y qué tan caro me va a salir”. Hoy, los costos de ciberseguridad en empresas ya no se miden solo en tecnología, sino en interrupciones operativas, sanciones regulatorias y pérdida de confianza del mercado. A modo de referencia reciente, un

La ciberseguridad ya no es una preocupación “a futuro”. Las amenazas que dominarán 2026 ya están ocurriendo hoy, afectando a empresas de todos los tamaños, sectores y regiones. Ataques más rápidos, automatizados y difíciles de detectar están redefiniendo la forma en que las organizaciones deben proteger su información. En este escenario, entender qué está cambiando

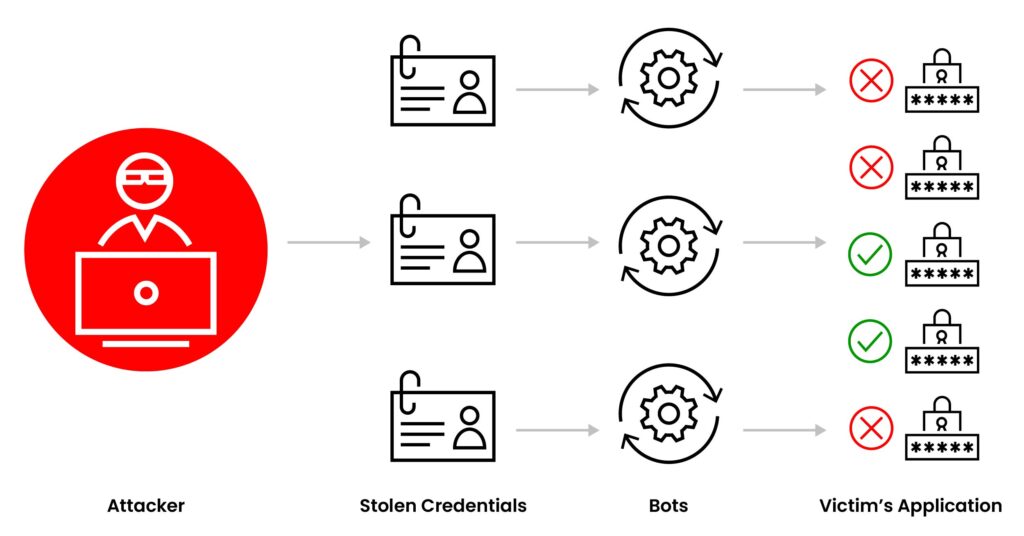

Te preguntas «¿Qué es Credential Stuffing?» Es un ataque automatizado donde delincuentes prueban, a gran escala, combinaciones de usuario y contraseña filtradas en otros servicios. Si un usuario reutiliza credenciales, el atacante accede sin necesidad de hackear el sistema. Spoiler: no son hackers con capucha adivinando contraseñas una por una, son bots probando miles por